Deepfakes já não são mais coisa de filme — em 2026 eles viraram armas digitais capazes de clonar voz e imagem com alto realismo. Como você checa se é real quando a pessoa que pede ajuda na tela parece exatamente quem você conhece?

O avanço dos deepfakes e suas aplicações maliciosas

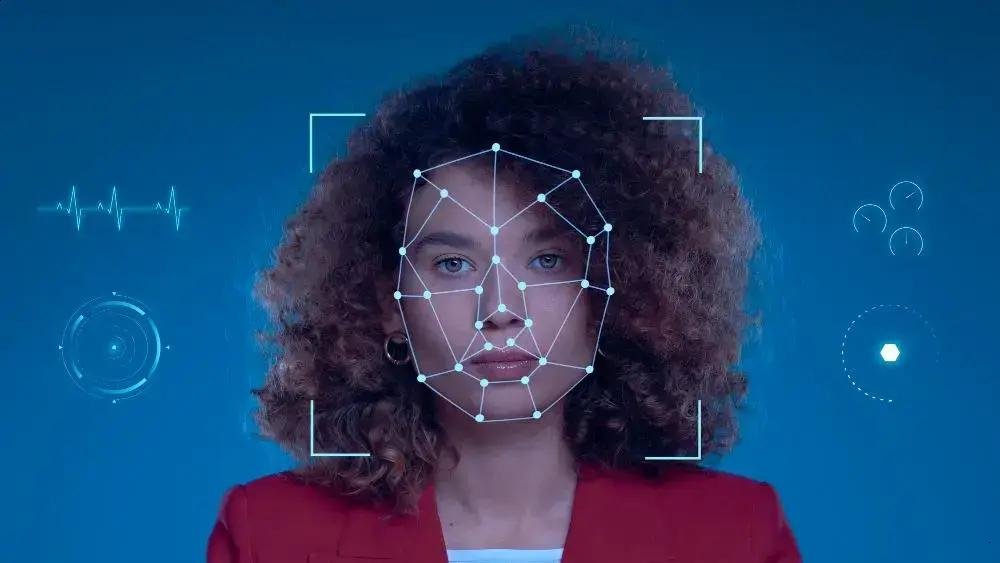

Deepfakes são conteúdos gerados por inteligência artificial que copiam voz e rosto. Nos últimos anos, a qualidade aumentou e virou um risco real.

Como a tecnologia evoluiu

Modelos treinados com grandes bancos de dados aprendem movimentos faciais e timbres de voz. Ferramentas acessíveis reduziram a barreira técnica, permitindo que mais pessoas criem deepfakes.

Principais aplicações maliciosas

Golpes financeiros usam clonagem de voz para pedir transferências urgentes a familiares. Em empresas, vídeos falsos pressionam executivos a assinar acordos sem adequada verificação. Partidos e agentes maliciosos também usam deepfakes para espalhar desinformação e manipular eleitores. Ainda há uso em pornografia não consensual e em extorsões que ferem a privacidade.

Por que é difícil detectar

Os deepfakes modernos exibem poucos artefatos visuais fáceis de notar, dificultando a checagem. Sistemas que analisam só imagem podem falhar diante de áudio sincronizado convincente. Evolução rápida das redes neurais complica o desenvolvimento de detectores eficientes.

Como se espalham

Plataformas sociais amplificam deepfakes quando usuários compartilham sem checar a fonte. Mensagens privadas, serviços pagos e fóruns especializados também facilitam a distribuição rápida.

Consequências e impactos

Vítimas enfrentam perda financeira, dano à reputação e grave sofrimento psicológico. Empresas perdem clientes e adotam processos mais caros para checar identidades.

Defesa e mitigação

Soluções modernas combinam análise de vídeo, áudio e metadados para detectar fraudes. Mesmo assim, a estratégia mais eficaz exige boas práticas humanas e checagem extra.

Por que defesas tradicionais falham: o novo patamar dos ataques

Deepfakes hoje superam muitas defesas antigas e causam riscos bem reais e rápidos.

Modelos mais avançados

Redes neurais são maiores e treinadas em enormes coleções de dados diversos. Isso permite gerar expressões faciais e timbres de voz muito parecidos com o real. Ferramentas acessíveis reduzem a barreira técnica para criar essas falsificações.

Ataques multimodais (áudio e vídeo juntos)

A maioria dos detectores antes analisava apenas imagem ou apenas áudio isoladamente. Agora os ataques unem áudio e vídeo de forma sincronizada e convincente. Isso confunde sistemas que não verificam os dois canais ao mesmo tempo.

Engenharia social e canais confiáveis

Golpistas hoje enviam deepfakes por mensagens e canais que parecem totalmente confiáveis. Pessoas tendem a confiar mais em vídeo e voz do que em texto escrito. Essa confiança humana torna defesas tecnológicas insuficientes em muitos casos.

Limitações técnicas dos detectores

Detectores treinados em exemplos antigos não reconhecem facilmente os novos truques. Adversários adaptam seus métodos para burlar esses detectores muito rapidamente. Análises puramente técnicas ignoram sinais como metadados e o contexto da mensagem.

Processos e políticas defasadas

Muitas empresas ainda usam processos manuais e lentos para checar identidade. Políticas antigas nem sempre cobrem deepfakes em comunicações oficiais e emergentes. Sem atualização, a prevenção fica sempre um passo atrás dos atacantes mais rápidos.

Como se proteger: medidas práticas e tecnologias de defesa multimodal

Deepfakes exigem medidas práticas e atenção constante nas comunicações digitais.

Boas práticas pessoais

- Verifique identidade por um segundo canal, como ligação ou mensagem separada.

- Use autenticação de múltiplos fatores sempre que possível.

- Evite transferências imediatas sem confirmação presencial ou por vídeo seguro.

- Não compartilhe arquivos sensíveis por canais não verificados.

- Peça detalhes que só a pessoa real saberia confirmar.

Medidas para empresas

- Implemente fluxos de verificação obrigatórios para pedidos financeiros e administrativos.

- Adote assinaturas digitais e certificados para documentos importantes.

- Treine equipes para identificar sinais de manipulação e engenharia social.

- Crie planos de resposta a incidentes claros e regularmente testados.

- Limite privilégios e valide operações críticas com mais de um aprovador.

Tecnologias multimodais

Ferramentas modernas combinam análise de áudio, vídeo e metadados ao mesmo tempo.

Watermarking invisível ajuda a provar a origem real de um arquivo.

Assinaturas criptográficas validam que um vídeo ou áudio veio de fonte confiável.

Liveness checks pedem respostas ao vivo, como movimento ou frases aleatórias.

Detecção multimodal reduz falsos negativos que surgem na checagem isolada.

Processos com revisão humana

Mesmo com tecnologia, revisão humana é essencial em casos sensíveis.

Crie checklists simples que equipes possam aplicar em decisões urgentes.

Combine automação com supervisão para bloquear fraudes e manter a confiança.

Fonte: Jovempan.com.br